戦略的パートナー

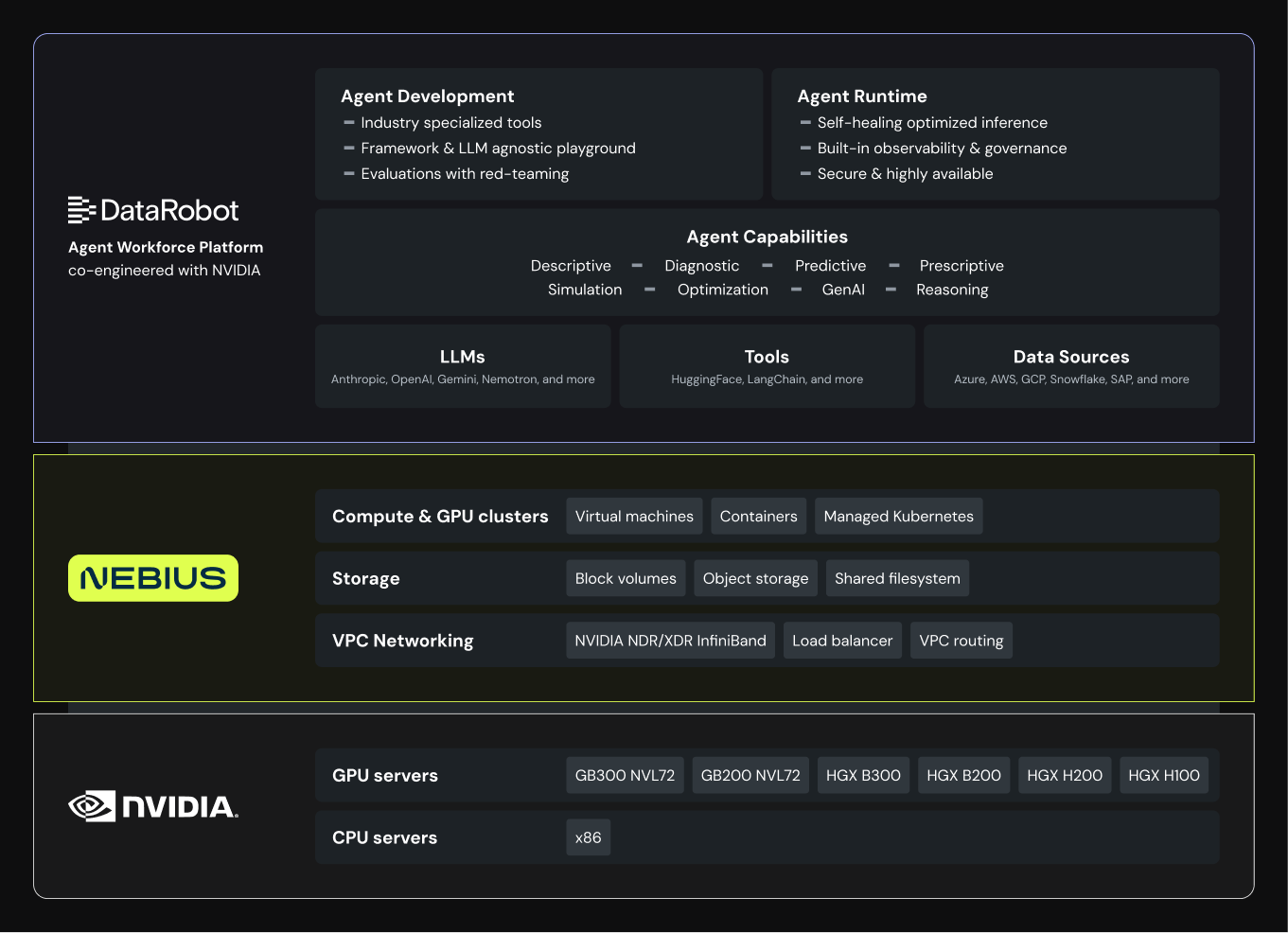

DataRobotとNebius

Nebius AIのクラウドインフラストラクチャとDataRobotのエージェントワークフォースプラットフォームを組み合わせることで、導入初日から持続的なパフォーマンス、予測可能なコスト、そしてライフサイクル全体にわたる管理を実現します。

お問い合わせ

本格的なエージェント体制を運用するために特別に設計された、実績のあるAIプラットフォーム。

GPUクラスターから本番環境で稼働するエージェントに至るまで、検証済みのAI基盤を構築しました。

DataRobotとNebiusは、エンタープライズ向けのエージェント専用に設計された、検証済みの「AI ファクトリー」を提供します。AI専用のGPUインフラと、フルスタックの追跡可能性およびガードレールを備えた本番仕様のプラットフォームを融合させ、自律型AIの実戦投入を実現します。

DataRobotとNebiusは、エンタープライズ向けのエージェント専用に設計された、検証済みの「AI ファクトリー」を提供します。AI専用のGPUインフラと、フルスタックの追跡可能性およびガードレールを備えた本番仕様のプラットフォームを融合させ、自律型AIの実戦投入を実現します。

エンタープライズのための専用設計。 既存の転用ではない、真の自律型AI。ドメイン固有のエージェント。あらゆるレイヤーに、一貫したガバナンスを。Nebius AI Cloud上の既存環境とシームレスに統合。検証済みスタックにより、予測可能なパフォーマンスと確実なコスト管理を実現します。

GPUの運用と確保に奔走するのは、もうやめにしましょう。今こそ、エージェントを実戦へ。

ビジネスを変革するエージェントを構築し、全社規模で展開する。GPUの順番待ちや、共有クラウドの制約に縛られる必要はもうありません。

- 専用GPUキャパシティを基盤に、80種類以上のモデルを選べるLLMゲートウェイと事前構築済みのエージェントテンプレートを活用。特定の領域に特化した専門エージェントを迅速に提供し、リソースの奪い合いを回避。

- ワンクリックでエージェントをデプロイ。組み込みのマルチテナント機能とトークン制御により、リソースを奪い合うことなく、複数のチームでインフラを効率的に共有可能。

- サプライチェーンからエネルギー、ライフサイエンスまで。部門を超えた「エージェントワークフォース」を、全社規模で展開。

確実なパフォーマンス。透明性の高いコスト。想定外の事態をゼロに。

専用GPUリソースにより、安定したパフォーマンスと予測可能なコストを実現します。また、DataRobotのトークン割当管理機能により、作業の遅延を招くことなく、すべてのチームが予算内に収まるよう管理されます。

- Nebiusの予約済み価格とDataRobotのトークン割当管理により、無駄のない投資を実現。

- 専用GPUキャパシティでエージェントを稼働させ、パフォーマンスの変動を排除。自己修復型推論が、高負荷下でも揺るぎない信頼性を維持。

- Nebiusのマルチテナント機能と、各エージェントを管理対象の範囲内に収めるDataRobotの組み込み制御機能を活用し、チーム間でGPUインフラを効率的に共有可能。

一度の構築で、あらゆる場所で動作し、すべてを統治する。

データは、今ある場所から動かす必要はありません。エージェントは、経済的およびパフォーマンスの面で最も理にかなった場所で動作し、どこへ展開しても、ガバナンスは途切れません。

- Nebius AI CloudにDataRobotエージェントを展開し、他のクラウド上のデータに接続します。強制的なデータ移行も、レジデンシーの妥協も、一切不要。

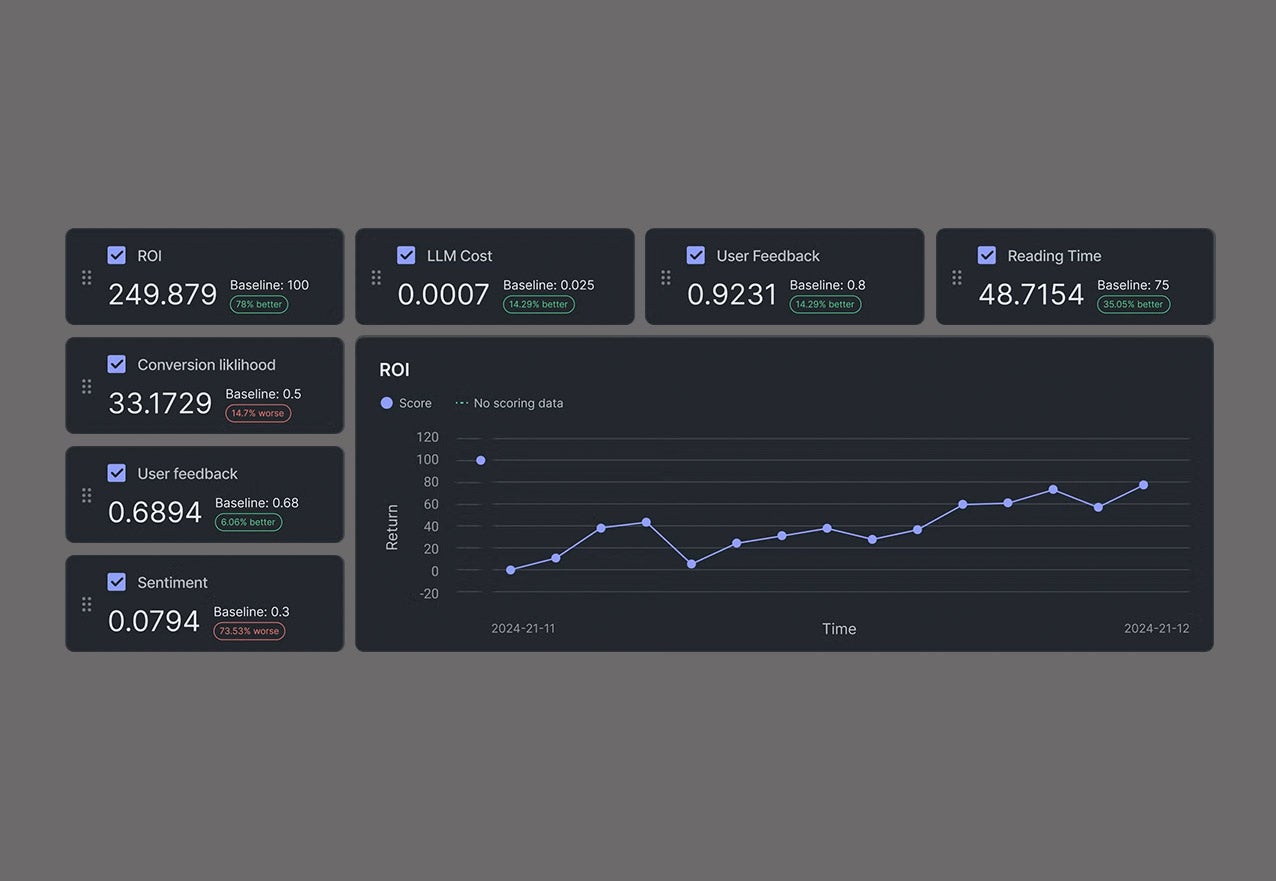

- DataRobotの統合オブザーバビリティ・ダッシュボードから、すべてのエージェントを監視し、あらゆるトークン利用を追跡。全社規模のAI労働力に対して、ガバナンス・ポリシーを確実に適用。

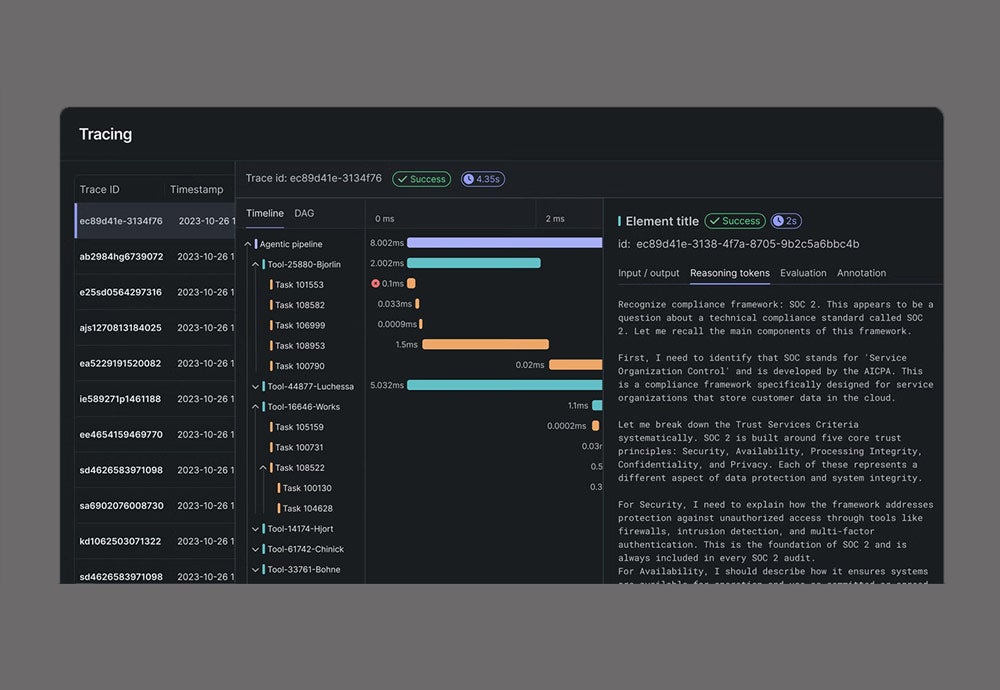

- OpenTelemetry(OTel)準拠のモニタリングとトレースを採用。稼働ステータス、リソース利用率、トークン使用枠をリアルタイムに追跡。

- エージェントを書き換えることなく、クラウド間やオンプレミス環境間でワークロードを移行可能。DataRobotは、必要な場所ならどこでも動作します。

検証済みのAIスタック。あらゆるレイヤーのエージェント向けに特別に設計されています。

NVIDIA H100、H200、B200、およびB300 GPUを搭載した専用クラスター上で、DataRobotのエージェントワークロードを実行します。リソースの共有も、性能の低下も、想定外のコストも、ありません。

DataRobotは、GPUを認識する高度なスケジューリング機能を備えたNebiusが管理するKubernetes上にデプロイされます。専用GPUワーカープールがハードウェア・アクセラレーション・コンポーネントを完全に分離し、CPUプールが全体のコスト効率を最適化します。

サーバーのプロビジョニングを行うことなく、オープンソースや主要な基盤モデル、さらにはNVIDIA Nemotronまでを、トークン課金のサーバーレス環境ですぐに試行できます。

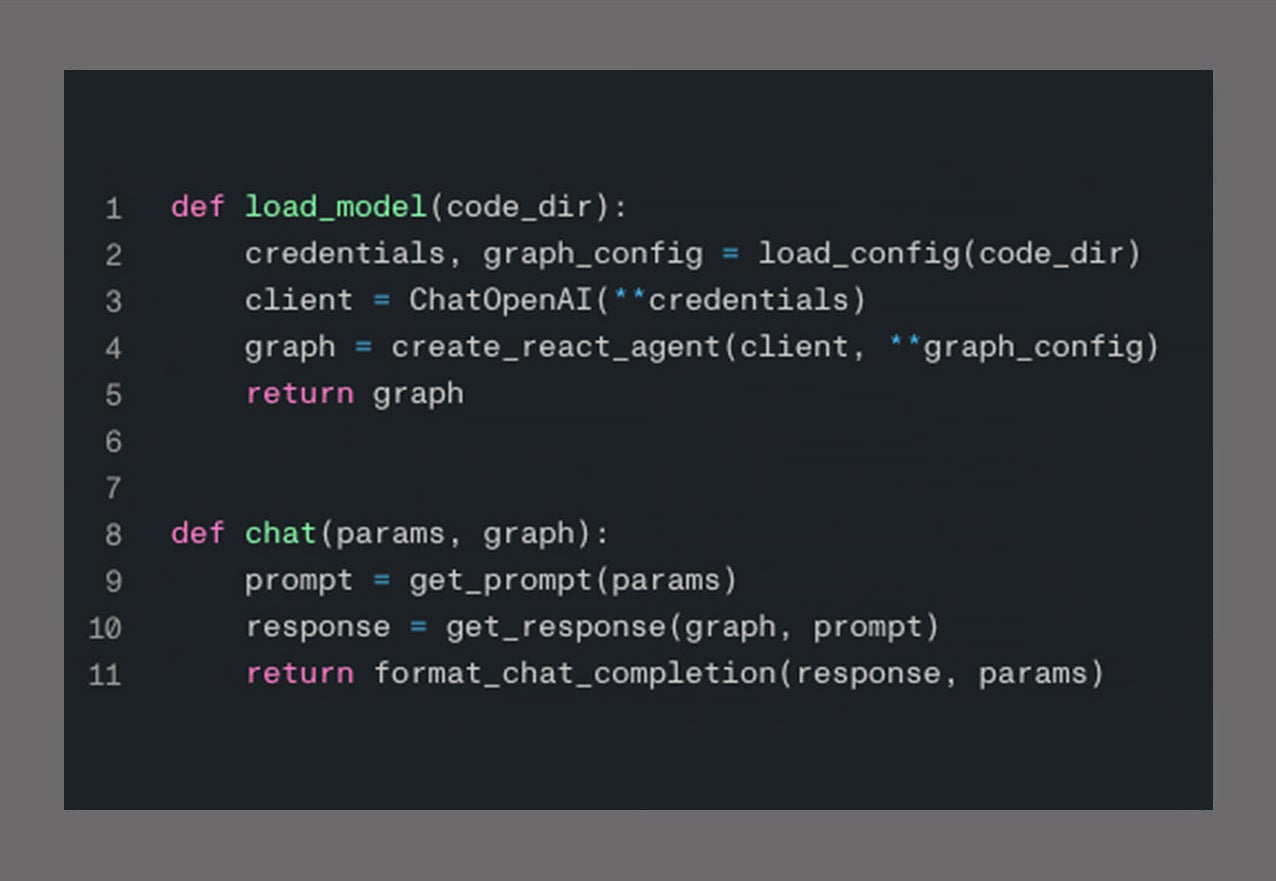

あらゆるフレームワークで構築された、コンテナ化済みのモデル、エージェント、アプリケーションをデプロイできます。たった一度のAPIコールで、ガバナンスが適用され、オートスケーリングとモニタリング機能が組み込まれたエンドポイントを即座に提供します。

本番環境への展開前に、忠実性、関連性、有害性を評価する組み込みの評価ツールを使用してエージェントを検証します。同じプラットフォーム上で、LLM-as-a-Judgeとヒューマン・イン・ザ・ループによるレビューを実行します。

OpenTelemetry(OTel)による監視とトレーシングを標準化。あらゆる環境において、エージェントの健全性、リソース利用率、トークン使用枠をリアルタイムに追跡します。

次世代のエージェントワークフォースの推進に向けた連携

GPUの争奪戦はやめましょう。エージェントを、実ビジネスへ。

業界初のAIハイパークラウドを、ぜひ貴社のチームにご活用ください。

お問い合わせ