本ブログはグローバルで公開された「Identity-first AI governance: Securing the agentic workforce」の抄訳版です。

AIエージェントは今や本番環境で稼働し、Snowflakeへのクエリ実行、Salesforceの更新、ビジネスロジックの自律的な実行を担うようになっています。しかし多くの企業では、こうしたエージェントの認証に、企業内のIDP(IDプロバイダ)における個別のアイデンティティではなく、静的なAPIキーや共有の認証情報が使われています。

共有の認証情報を介して自律型システムを認証することは、ガバナンス上の重大なリスクをもたらします。

エージェントが何らかのアクションを実行した場合、ログには明確に定義された自律的なアクターではなく、開発者のキーやサービスアカウントとして記録されることがよくあります。これにより責任の所在が曖昧になり、最小権限の原則も機能しにくくなるのです。さらに、権限を取り消す際にも、管理されたアイデンティティを無効化するのではなく、認証情報のローテーションやコードの修正が必要になることがあります。非決定的な環境において、このような遅延は原因究明や被害の封じ込めを遅らせる要因となるでしょう。

共有の認証情報を使用することは、自律型システムを「シャドー・アイデンティティ」に変えてしまいます。つまり、企業のディレクトリ内で明確に管理されたアイデンティティを持たないまま、本番環境内で動作するアクターを生み出してしまうことになります。

多くの組織では、すでに監視体制やガードレールが整備されています。問題は構造的な部分にあると言えます。自律型システムが、人間のユーザーを保護するのと同じコントロールプレーンにおいて、(人間の従業員と同等の管理対象として)第一級のアイデンティティ・ガバナンスの外側で稼働しているのです。このギャップを埋めるためには、従業員を管理するアイデンティティ・モデルとエージェントを連携させ、すべての自律的アクターを追跡可能にし、権限を適切に制限し、中央集権的に権限の取り消しができるようにする必要があります。

潜むリスク:現代のエージェンティックAIの「非決定論的」な性質

従来のエンタープライズ・ソフトウェアは、あらかじめ定義されたロジックに従って動作します。同じ入力があれば、常に同じ出力が得られるものです。

しかし、エージェント型AIシステムはこれとは異なります。固定されたスクリプトを実行するのではなく、確率的モデルを使用して以下のような処理を行います。

- コンテキストの評価

- 情報の動的な検索と取得

- リアルタイムでのアクションパスの構築

例えば、サプライチェーンのルート最適化をエージェントに指示した場合、ルートを決定する前に、天気予報や燃料費のデータ、過去の実績などを参照する可能性があります。このような柔軟性があるからこそ、エージェントは従来のソフトウェアでは対応できない、複数のシステムにまたがる複雑な問題を解決できるようになります。

その反面、非決定論的なシステムは、ガバナンスにおいて新たな課題をもたらします。

- 実行経路がリクエストごとに異なる可能性がある。

- コンテキストによって取得されるデータソースが変わる。

- 出力に推論の誤りや不正確な結論が含まれるケースがある。

- 開発者が明示的にスクリプト化した範囲を超えてアクションが及ぶ可能性がある。

システムが継続的に自社データにアクセスし、自律的にアクションを実行できる場合、静的なアプリケーションと同じように管理することはできません。明確なアイデンティティの割り当て、厳密に制限された権限、継続的な監視、そして権限取り消しの中央集権的な権限が必要となるのです。

エージェント型環境で認証情報ベースのセキュリティが破綻する理由

大半の企業は依然として、静的なAPIキーや共有サービス認証情報を使用してAIエージェントのセキュリティを確保しています。このモデルは、ソフトウェアが予測可能なロジックを実行していた時代には機能していました。しかし、自律型システムが本番環境全体で稼働するようになると、この手法は破綻してしまいます。

エージェントが共有の認証情報で認証された場合、アクティビティはログに記録されますが、その主体が明確に特定されません。Salesforceの更新やSnowflakeへのクエリが、独立した自律型システムからではなく、開発者のキーから発生したように見えてしまうことがあります。責任の所在が曖昧になり、最小権限の原則を徹底することが難しくなるのです。また、問題発生時の封じ込めも、管理されたアイデンティティを無効にするのではなく、認証情報のローテーションやコードの修正に頼らざるを得なくなります。

ここでの問題は、監視の可視性ではなく、アイデンティティ・ガバナンスそのものにあります。

従来のセキュリティは、認証情報が責任を負うべきユーザーやサービスに紐づいていることを前提としています。共有の認証情報はこの前提を崩してしまうものです。非決定的な環境において、このような曖昧さは調査を遅らせ、リスクへの露出を高めることにもつながります。

戦略的な転換:アイデンティティファーストのガバナンス

シャドー・アイデンティティによって生じるガバナンスの空白は、監視を強化するだけでは解決できません。自律型システムの管理方法そのものに構造的な転換が求められています。

データを動的に検索し、確率的な出力を生成し、エンタープライズプラットフォーム全体でアクションを実行できるシステムは、もはや単なるアプリケーションではありません。それは一つの運用「アクター」であり、ガバナンスもその事実を反映したものである必要があります。

アイデンティティファーストのガバナンスは、自律型システムを、人間のユーザーを管理するのと同じディレクトリ内の第一級のアイデンティティとして扱います。各エージェントには個別のアイデンティティが与えられ、明確に制限された権限と、監査可能なアクティビティの属性が割り当てられるのです。

これにより、コントロールのモデルが変わります。アクセスは静的な認証情報ではなく、アイデンティティに紐づくようになります。アクションは特定のアクターに記録され、コードを変更することなく権限の調整が可能になります。そして権限の取り消しは、アプリケーションのロジック内ではなく、アイデンティティのレイヤーで行われることになります。

その結果、人間と自律型アクターの両方に対応する統合されたアイデンティティ・プレーンが実現します。組織はAI専用のセキュリティスタックを並行して構築するのではなく、既存のアイデンティティ管理を拡張すればよいのです。ポリシーの一貫性は保たれ、インシデント対応も中央集権的に維持されます。ガバナンスを断片化させることなく、イノベーションを安全に拡大させることができるでしょう。

実践例:アイデンティティに裏打ちされたエージェントの運用

アイデンティティ・ガバナンスの空白に対するアーキテクチャ上の解決策の一つは、自律型システムを静的なAPIキーで認証するのではなく、企業のディレクトリ内で第一級のアイデンティティとしてプロビジョニングすることです。

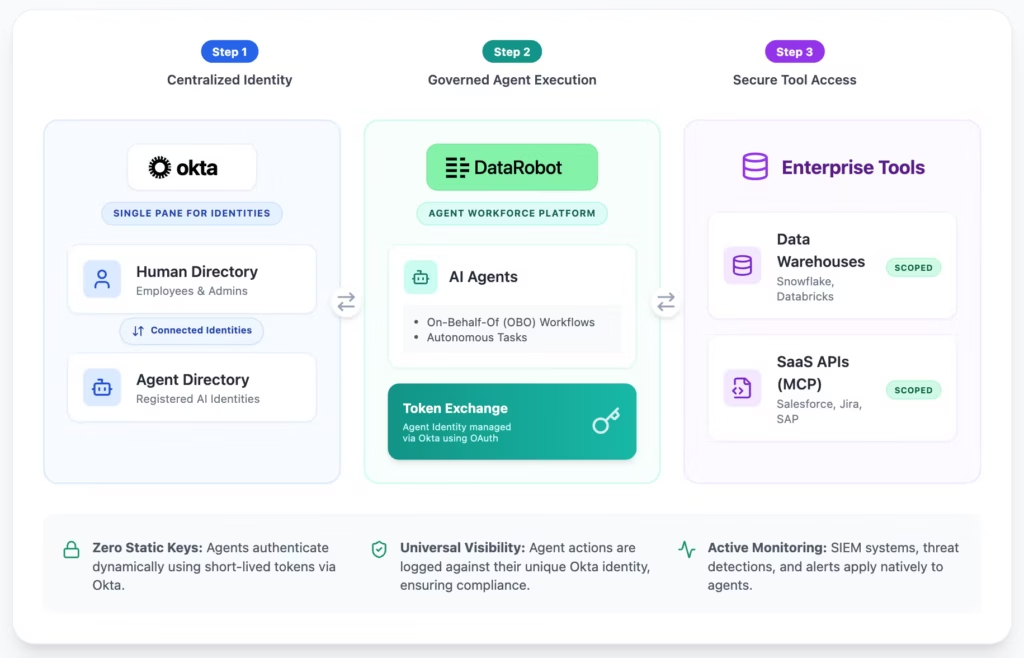

このアプローチには、エージェントのオーケストレーションとエンタープライズのアイデンティティ・インフラストラクチャとの連携が不可欠です。DataRobotとOktaの深い統合により、組織はDataRobotのエージェントワークフォースプラットフォームで構築されたエージェントを、管理された第一級のアイデンティティとして直接Okta内にプロビジョニングできるようになりました。エージェントワークフォースプラットフォーム内にデプロイされたエージェントは、共有の認証情報に依存することなく、Okta内の管理されたアイデンティティとして扱うことが可能になります。

このモデルでは、各エージェントがディレクトリに裏付けられたアイデンティティを受け取ります。認証は、コードに埋め込まれた寿命の長い認証情報ではなく、ポリシーによって制御された有効期限の短いトークンを介して行われます。アクションは特定の自律的アクターのログとして記録され、権限は既存の最小権限コントロールを用いて適切に制限されるのです。

これにより、先述した責任の所在と権限取り消しの課題が直接的に解決されます。エージェントがデプロイされると、企業のIDP内にそのアイデンティティが作成されます。権限が変更された場合には、ガバナンスのワークフローが適用されます。もしエージェントの挙動が期待から逸脱した場合は、セキュリティチームがアイデンティティ・レイヤーでエージェントを制限または無効化し、SalesforceやSnowflakeなどの統合システムへのアクセスを即座に調整することが可能になるのです。

その影響は運用の現場に明確に現れます。自律型システムは、人間のユーザーを保護するのと同じアイデンティティ・プレーンの中で可視化されたアクターとなります。並行するAIセキュリティスタックを新たに導入するのではなく、すでに運用と監査を行っているコントロールを拡張するだけで済むのです。

エージェント型AIのための3つのガバナンス原則

自律型システムが本番環境へ移行するにつれて、ガバナンスはより明確なものでなければなりません。最低限、以下の3つの原則が不可欠と言えるでしょう。

1. 静的な認証情報の排除

自律型システムは、寿命の長いAPIキーや共有のサービスアカウントを通じて認証されるべきではありません。本番環境のエージェントは、管理されたアイデンティティに紐づく、ポリシーによって制御された短寿命の認証情報を使用する必要があります。自律型システムがエンタープライズシステムにアクセスできる場合、アイデンティティ・プロバイダ内で独立したアクターとして認証されなければなりません。

2. プラットフォームではなくアクターを監査する

セキュリティログは、一般的なサービスや開発者のキーではなく、特定の自律的なアイデンティティにアクションを紐づけるべきです。非決定論的なシステムにおいて、プラットフォームレベルでの可視性だけでは不十分です。調査、異常検知、アクセスレビューを支援するためには、アクターレベルで属性を管理するガバナンスが求められます。

3. 権限取り消しの中央集権化

セキュリティチームは、主要なアイデンティティのコントロールプレーンを通じて、自律型システムを制限または無効化できなければなりません。被害の封じ込めを、コードの変更や認証情報のローテーション、再デプロイに依存してはなりません。アイデンティティは、運用をコントロールするための基盤として機能する必要があるのです。

非決定論的なシステムが、本質的に危険というわけではありません。しかし、自律型システムがアイデンティティレベルでのガバナンスなしに稼働する場合、リスクは増大します。明確なアイデンティティの境界を設けることで、自律性はガバナンス上の負債から、管理可能でエンタープライズの運用を拡張させる強力な武器へと変わるのです。

AIガバナンスはワークフォース・ガバナンスである

エージェント型システムは今やコアなワークフローの内部で稼働し、規制対象のデータにアクセスし、実際の結果を伴うアクションを実行しています。決定論的なソフトウェア向けに設計された従来のガバナンスモデルでは、自律型システムに対応するには不十分です。

システムがアクションを起こせるのであれば、それは従業員(ワークフォース)を保護するのと同じコントロールプレーンの中で、管理されたアイデンティティとして存在していなければなりません。アイデンティティこそが、責任の所在、最小権限、監視、そして中央集権的な権限取り消しの基盤となります。エージェントが企業のディレクトリの外側ではなく内側で稼働することで、イノベーションの拡大に合わせて監視体制もスケールさせることができるようになるのです。

このモデルは、エージェントのオーケストレーション・プラットフォームと、エンタープライズ・アイデンティティ・プロバイダの緊密な統合によって具体化されつつあり、DataRobotとOktaのコラボレーションもその一つです。AIセキュリティスタックを新たに並行して構築するのではなく、すでに運用しているアイデンティティ・インフラストラクチャを自律型システムへと拡張することが可能です。アイデンティティに裏打ちされたエージェントが、エンタープライズ環境内でいかに安全に稼働するかについて詳しくは、Webサイトをご覧いただくか、デモをご予約いただき、DataRobotとOktaがどのようにエージェントのオーケストレーションとエンタープライズのアイデンティティ・ガバナンスを統合しているかをご確認ください。