AI ガバナンス

すべての AI アセットを 1 カ所で管理: AIエージェント、生成 AI、予測 AI のすべての AI の監視を、アセットの構築場所やデプロイ先に関係なく一元化します。UI または API を通じて、組み込みの指標、ガードレール、リアルタイムの介入によるシームレスな管理と監視が可能です。

クラウド、プライベートクラウド、ハイブリッド、オンプレミス、エッジまで、あらゆる環境に対応する AI ガバナンス

DataRobot の UI またはコードファーストを自由に選択

モデル、LLM、エージェント、ツール、アプリ、ベクターデータベースを管理する中央ハブ

DataRobot からあらゆる場所にデプロイ

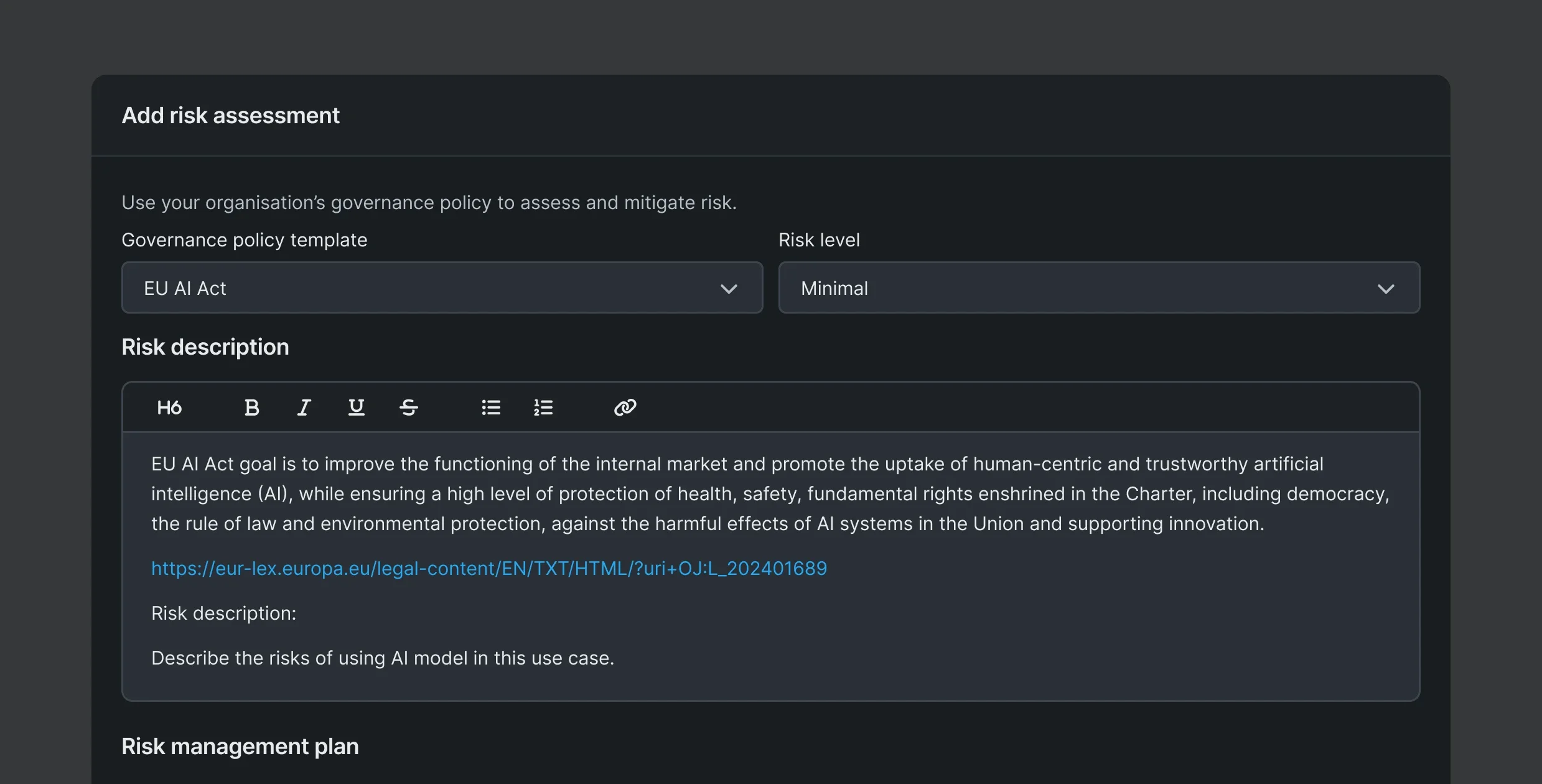

すべてのコンプライアンス基準の遵守を自動化: 開発段階でのテストから本番環境での継続的なコンプライアンス評価までを自動化し、コンプライアンスリスクを軽減します。生成 AI と予測 AI のデプロイに関するドキュメントを、用途に合わせてワンクリックで作成できるため、時間を節約できます。

AI コンプライアンス: EU AI 法、ニューヨーク市法第 144 号、コロラド州法 SB21-169、カリフォルニア州法 AB-2013、SB-1047

基準とガイドライン: EEOC AI ガイダンス、DIU が責任を負う AI ガイドライン

AI 管理フレームワーク: NIST AI RMF、SR-117

Industry best practices such as The Data & Trust Alliance

AI リスクを軽減してポリシーを適用: すべての AI プロジェクトにおいてリスクを最小限に抑え、MRM ポリシーを守ります。組み込みのフレームワーク(EU AI 法、NIST、またはカスタム)を利用し、各ステップで監査に対応した証拠を簡単に収集、保管できます。カスタマイズ可能なゴールドスタンダードのシールドと、標準化された承認ワークフローを活用して、あらゆる AI アセットに対して一貫したガバナンスポリシーを適用します。

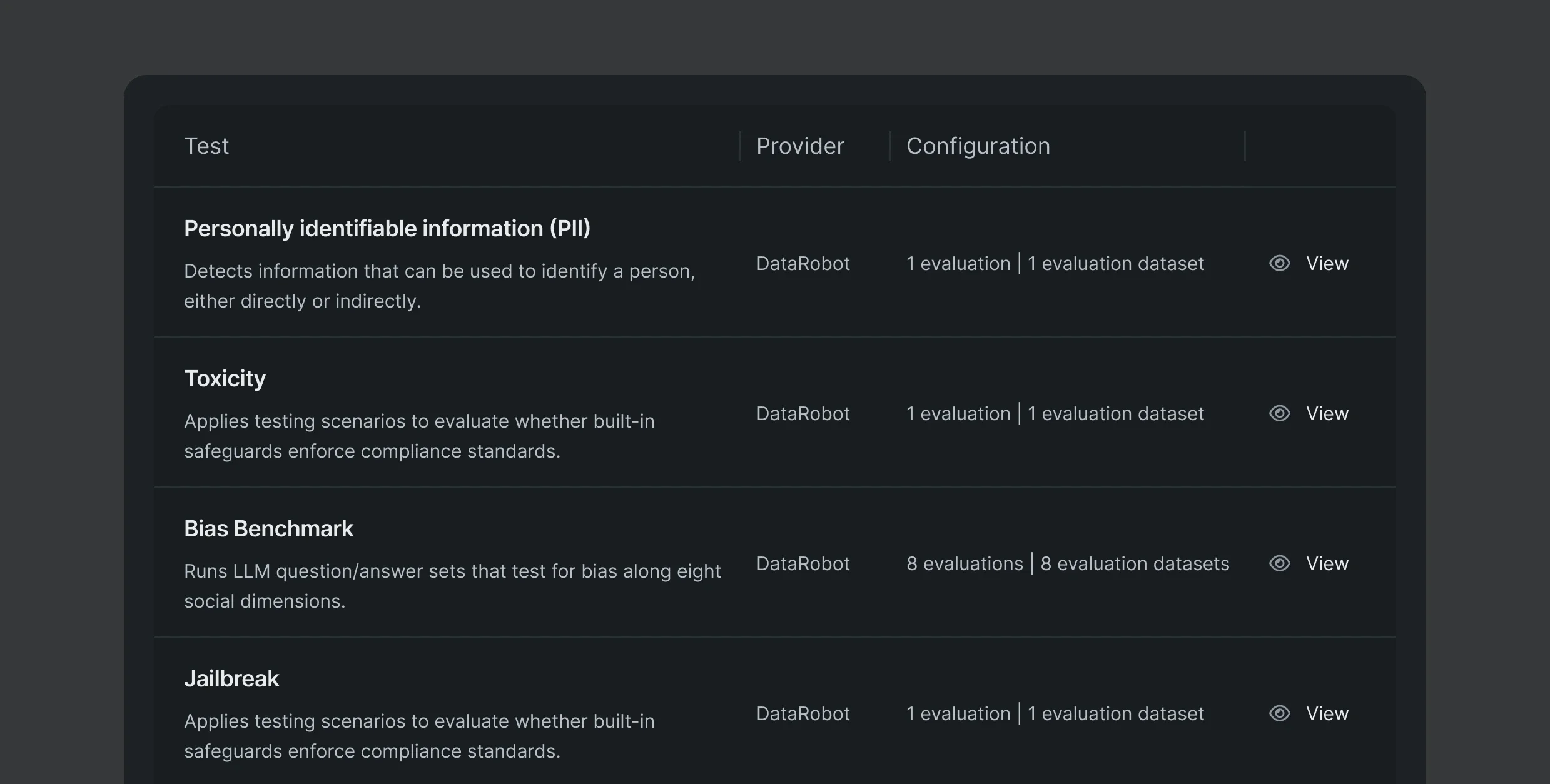

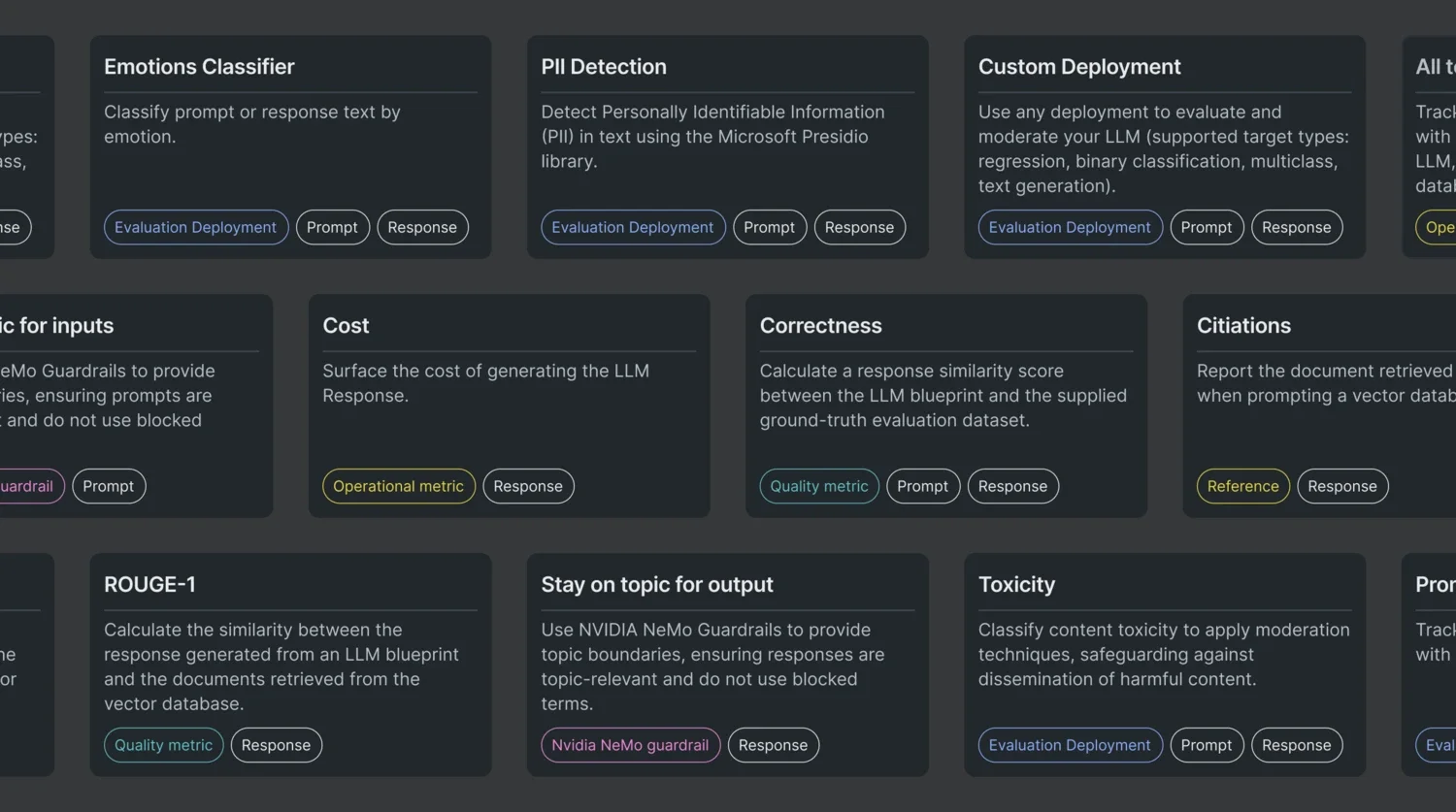

リアルタイムで行う介入とモデレーション: シールドとガードレールの包括的なライブラリーを活用して、PII リーケージ、プロンプトインジェクション、ハルシネーションなど、OWASP が特定した脆弱性から AI デプロイを保護します。NVIDIA 社や Microsoft 社から提供されている、すぐに使えるカスタマイズ可能なガードレールを活用すれば、ビジネスに影響が及ぶ前に脅威を監視、検出、解決できます。

PII リーケージ、プライバシーの侵害

トピックからの逸脱、ハルシネーション、ポリシー違反

有害性、バイアス、虚偽の情報

ROUGE-1、忠実性

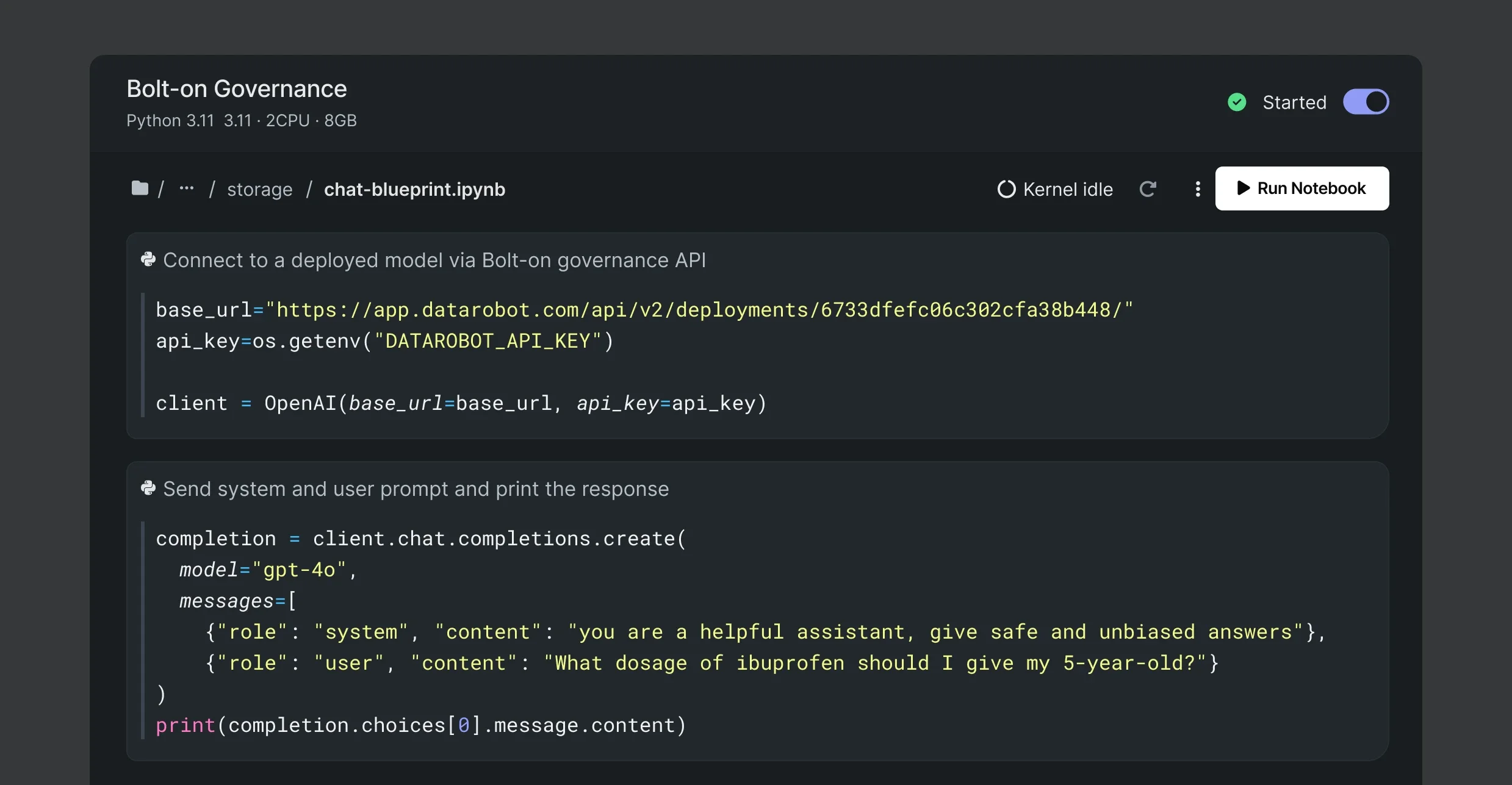

構築した人や場所を問わず、あらゆる AI アセットを保護: モデル、エージェント、アプリケーションといったすべての AI アセットを、ホストされている場所に関係なく、わずか 2 行のコードで保護および管理できます。包括的なガバナンスポリシーとカスタム指標を使用して、リアルタイムの監視およびモデレーションを実施します。こうした防御を自動化することで、組織内のすべてのデプロイに対して堅牢な保護を実現します。

AI デプロイ前のレッドチーミング評価: AI をデプロイする前にレッドチーミング評価を実施することで、モデルの堅牢性と安全性を確保します。合成データセットやカスタムデータセットを用いてテストを行い、ジェイルブレイク、バイアス、不正確さ、有害性、コンプライアンス上の問題を早期に発見し、脆弱性に対処します。

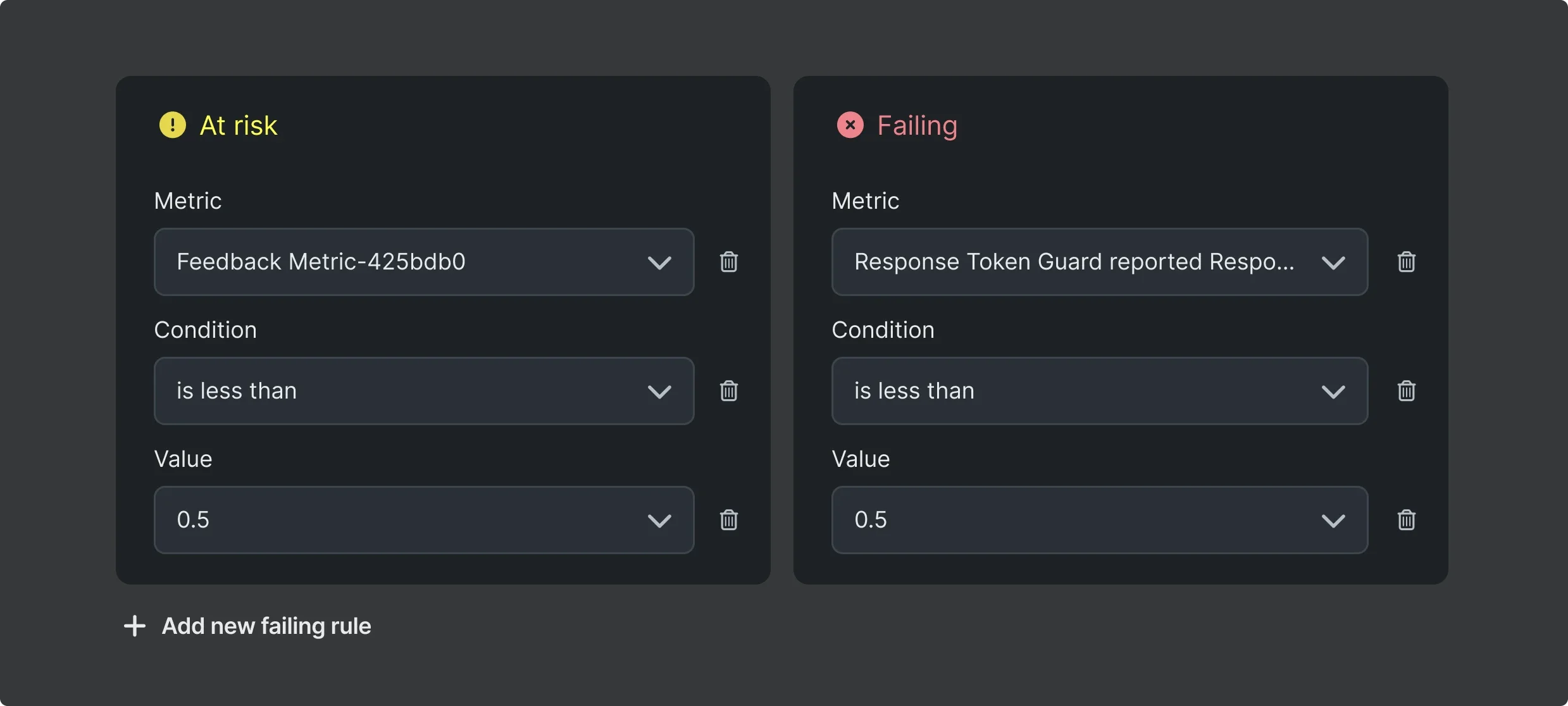

カスタムアラートと通知ポリシー: データサイエンスアプリケーションまたは SIEM ツールで、リアルタイムの指標とカスタマイズされたアラートを取得し、適切なチームが迅速に対応できるようにします。

デプロイの複雑さを軽減: 予測 AI および生成 AI モデル、エージェント、アプリを、整理された 1 つのレジストリーからデプロイできます。ワンクリックで、パイプライン、ベクターデータベース、プロンプト戦略を本番環境対応の REST API に自動でパッケージ化します。

クラウドへのデプロイ

エッジへのデプロイ

ビジネスアプリケーションへの組み込み

オンプレミスやエアギャップ環境への対応

コンピューティングリソースをリアルタイムで最適化: サーバーレス環境を採用してコンピューティングリソースのプロビジョニングと解放を自動化し、無駄を排除することで、パフォーマンスとコスト効率を最大化します。コスト、レイテンシー、可用性などの優先順位を設定するだけで、DevOps のオーバーヘッドを軽減できます。手作業で調整しなくても、ベクターデータベースの更新を高速化し、ガードレールのパフォーマンスを改善し、レイテンシーを削減できます。

gpu_ex = cc.CloudExecutor(num_cpus = 124,

num_gpus = 4,

gpu_type = "h100")

@ct.electron(executor = gpu)

def fine_tune_llm(**data):

# fine tune model with requested GPU

...

return modelNVIDIA を利用してセットアップなしでエージェントをデプロイ: 新しい NVIDIA NIM のギャラリーを使用すると、事前に構築済みで GPU 向けに最適化された NVIDIA NIM を迅速にデプロイ可能です。複雑な手作業は不要です。DataRobot のエージェント型アプリをカスタマイズして NIM マイクロサービスを活用したり、NeMo ガードレールを使ってすべての AI アプリを保護することができます。

# Create prediction environment for the Agent LLM and tool deployments

prediction_environment = datarobot.PredictionEnvironment(

resource_name="TTMD serverless prediction environment",

platform="datarobotServerless",

)

# Retrieve Llama NIM 3.3 70B model from DataRobot Model Directory

registered_model = datarobot.RegisteredModel.get(

resource_name="NIM - Llama 3.3 70B",

id="6810f0b32e1c63a55912350a",

)

# Create Llama 3.3 70B NIM deployment

deployment = datarobot.Deployment(

resource_name="NIM - Llama 3.3 70B",

registered_model_version_id=registered_model.version_id,

prediction_environment_id=prediction_environment.id,

label="NIM - Llama 3.3 70B",

use_case_ids=[use_case.id],

)AI パイプラインを大規模にオーケストレーション: バッチジョブでもリアルタイムアプリでも、パイプラインのすべての段階で途切れることのないパフォーマンスを確保します。Airflow とのネイティブ統合により、バッチワークフローの実行および監視が可能です。事前構築済みのカスタマイズ可能なブループリントを活用してリアルタイムワークフローをすばやく構築し、コンピューティングリソースの動的なオーケストレーションを通じて最適化します。

@dag(

start_date=datetime(2025, 4, 22),

schedule="@daily",

max_active_runs=1,

tags=["example", "csv", "wrangling", "modeling"],

params={

"dataset_file_path":

"https://s3.amazonaws.com/datarobot_public_datasets/10k_diabetes.csv",

"project_name": "hospital-readmissions-example",

"autopilot_settings": {"target": "readmitted", "mode": "quick",

"max_wait": 3600},

},

)